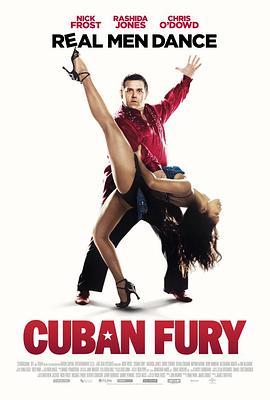

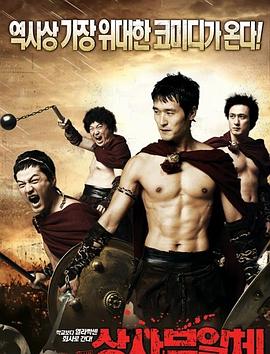

ICML2021提出的百万维参数优化中的自动数据采样方法,主要围绕样本重要性定义、高维参数空间建模、动态样本权重学习及系统资源优化等核心问题展开,具体内容如下:样本重要性定义传统方法依赖LOSS等指标衡量样本重要性,但存在局限性:不同体系下样本角色可能变化(如从hard negative变为outlier),且LOSS无法本质反映重要性。研究提出以验证集表现为reward的自动化采样框架,核心原则是数据采样服务于模型训练目标(测试集取得更好结果),通过验证集性能直接指导样本重要性评估。图:自动化数据采样流程图,强调密集的online reward机制高维参数空间建模与采样面对百万维参数空间,传统policy network难以有效建模样本权重。研究通过以下策略缓解问题:丰富准确的reward:通过机器问题与策略优化,发现仅需少量训练迭代(small iteration)即可获得高质量reward,减少对复杂reward机制的依赖。简化建模:采用无参估计替代复杂policy network更新,降低建模复杂度。通过上述方法,实现1M以上数据权重的高效online更新。动态样本权重学习实验发现,模型不同阶段对样本权重的需求不同,动态分布优于固定分布。尽管原因未明,但验证了动态调整的必要性。系统设计中加入均匀分布作为基础,防止样本概率降为0导致reward失效,确保采样稳定性。系统资源优化与复用性资源消耗:系统需32×8个V100 GPU,在ImageNet上训练半个月,资源需求较高。复用性发现:多解存在:同一任务存在多个有效动态分布,多次运行可验证。跨结构通用:不同网络结构学习的动态分布可复用,且与数据集强相关,而非模型结构本身。图:不同网络结构的数据动态分布具有通用性行业趋势与展望研究提出大数据(多领域)+大模型(一次训练多场景适用)+自动微调(自动采样)的趋势,并延伸至产业层面:数据贡献:通过自监督/无监督/多模态技术释放数据红利。模型部署:按需调用不同算力档位的网络模块。行业定制:结合业务需求筛选或复用数据集。进一步预测未来格局:研究员分散化:研究力量向业务方倾斜,传统研究院影响力减弱。算力集中化:云厂商垄断算力资源。产品线数据化:数据与需求集中于产品端(如滴滴、短视频平台),成为核心价值与突破难点。核心观点:AI是技术手段,需与业务、数据深度结合才能实现产品化价值。