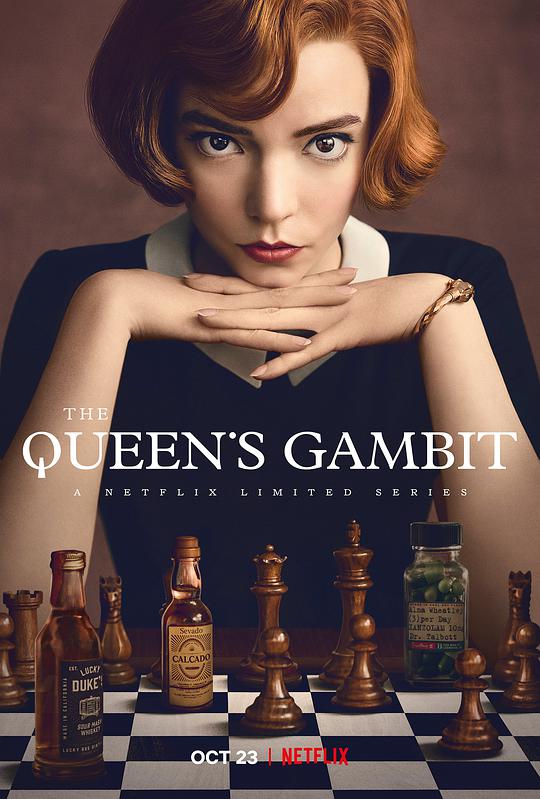

提示词优化存在明确边界,过度复杂的提示词反而会降低模型表现。大模型的注意力机制本质是通过数学计算实现信息筛选,提示词的作用是引导而非绝对控制,其效果受模型能力上限和任务性质的双重约束。一、提示词优化的本质与边界注意力聚集的有限性大模型通过自注意力机制(公式:Attention(Q,K,V)=softmax(QK?/√d)V)实现输入序列的全局关联建模。提示词的作用是调整Query(当前问题)、Key(上下文关联)、Value(信息整合)的权重分配,但这一过程存在物理极限:计算资源限制:模型上下文窗口长度固定(如2048 tokens),超长提示词会导致信息截断或权重稀释。概率生成本质:即使temperature=0,模型输出仍存在微小变异,无法保证100%确定性。例如,要求“用三句话解释量子力学”时,模型可能因词汇选择差异产生不同表述,但核心概念覆盖率受提示词约束。能力边界的双重约束模型能力天花板:大模型无法突破其训练数据和架构的限制。例如,要求模型执行精确的文件I/O操作或事务性数据库查询,必然因缺乏底层控制能力而失败。任务性质匹配度:提示词在“高层意图表达”(如内容创作、任务规划)中效果显著,但在“底层确定性逻辑”(如数据格式校验、循环控制)中表现脆弱。例如,用提示词实现if-else结构极易因输入微小变化导致逻辑错误。二、提示词失效的典型场景与原因过度约束导致注意力分散案例:在创作科幻小说时,若提示词同时要求“包含时间循环、外星文明、量子纠缠、人类与AI的信任危机,且用三句话解释核心矛盾”,模型可能因关键词过多而无法聚焦。机制:多头注意力机制虽能并行处理不同关系(如因果、时间、情感),但当关键词超过模型注意力头的处理容量(通常8-16个)时,权重分配会趋于平均化,导致核心信息被稀释。矛盾指令引发逻辑混乱案例:要求模型“同时生成喜剧和悲剧风格的剧本”,模型可能输出荒诞派内容或直接报错。机制:自注意力机制通过Query-Key相似度计算分配权重,矛盾指令会导致权重矩阵归一化失败(softmax输出趋近均匀分布),最终上下文向量C=AV无法收敛到有效信息。超出模型知识范围的指令案例:要求模型“用2025年未发布的科技解释气候变化”,模型可能生成虚构内容或拒绝回答。机制:大模型的注意力机制仅能激活训练数据中存在的关联,若提示词涉及未学习过的知识,Value向量(值向量)中无有效信息可供加权聚合。三、如何判断提示词接近边界?输出质量下降的信号重复或空洞内容:模型因注意力权重分散而反复使用安全词汇(如“这是一个有趣的问题”)。逻辑跳跃:在任务分解提示词中,模型生成的子任务缺乏关联性(如第一步“研究气候数据”,第二步“设计外星飞船”)。拒绝执行:模型直接返回“作为AI语言模型,我无法……”的提示,表明任务超出能力范围。实验验证方法AB测试对比:提示词A:“写一首诗” → 输出随机主题诗歌。提示词B:“写一首关于深海孤独的俳句,包含潜艇、水压、荧光鱼群” → 输出聚焦特定意象的诗歌。若B的输出质量显著高于A,说明提示词有效;若B输出混乱,则可能接近边界。注意力热力图观测:通过可视化工具(如BERTviz)分析模型对提示词中关键词的关注程度。若核心关键词(如“气候变化”)的注意力权重低于无关词(如“今天”),则提示词需优化。破坏性测试:故意输入矛盾提示词(如“生成一个既乐观又悲观的新闻标题”),观察模型输出。若输出荒诞或报错,说明提示词已超出模型处理能力。四、最佳实践:混合大模型与传统工具分层协作架构顶层(提示词驱动):用自然语言提示词完成意图理解、任务规划、内容生成。例如,通过提示词让模型“生成一份关于气候变化的PPT大纲,包含数据来源和可视化建议”。底层(传统代码驱动):用Python等确定性语言实现数据校验、格式转换、API调用。例如,用代码将模型生成的PPT大纲转换为标准PPT文件,并确保数据图表符合规范。提示词设计三原则锚定法则:用具体关键词(如“赛博朋克城市”“机械义眼”)替代模糊指令(如“写个故事”),为模型提供明确聚焦点。结构法则:通过分幕剧本(如[背景灯光:赛博朋克城市][主光束:主角的机械义眼特写])引导模型分层构建内容,避免逻辑跳跃。熵减法则:用信息约束(如“用三句话解释量子力学”)限制模型输出范围,防止注意力分散。图:学界通过自优化提示词智能体探索能力边界提示词优化的核心是“在模型能力范围内最大化注意力聚焦”。理解自注意力机制的数学本质、识别任务与模型的匹配度、通过实验验证提示词效果,是避免过度调优的关键。最终目标不是“控制”模型,而是通过精准的提示词设计,让模型在自身能力边界内发挥最佳表现。